一句话需求,爪爪帮我把猫拍成了短片

今天我家猫把自己关进了浴室。

它不知道怎么开门,就在里面叫。

我当时第一反应不是去救它——而是:这个场景,能不能做成视频?

我做了什么?发了张照片,说了句话

就是这位主角 👇

拍了张照片发给爪爪,说了大概这么个意思:帮我基于这只猫的形象生成一条短视频。

就这样。没写 prompt,没选模型,没指定参数。整个过程我大概花了2分钟。

然后爪爪接手了所有事情。

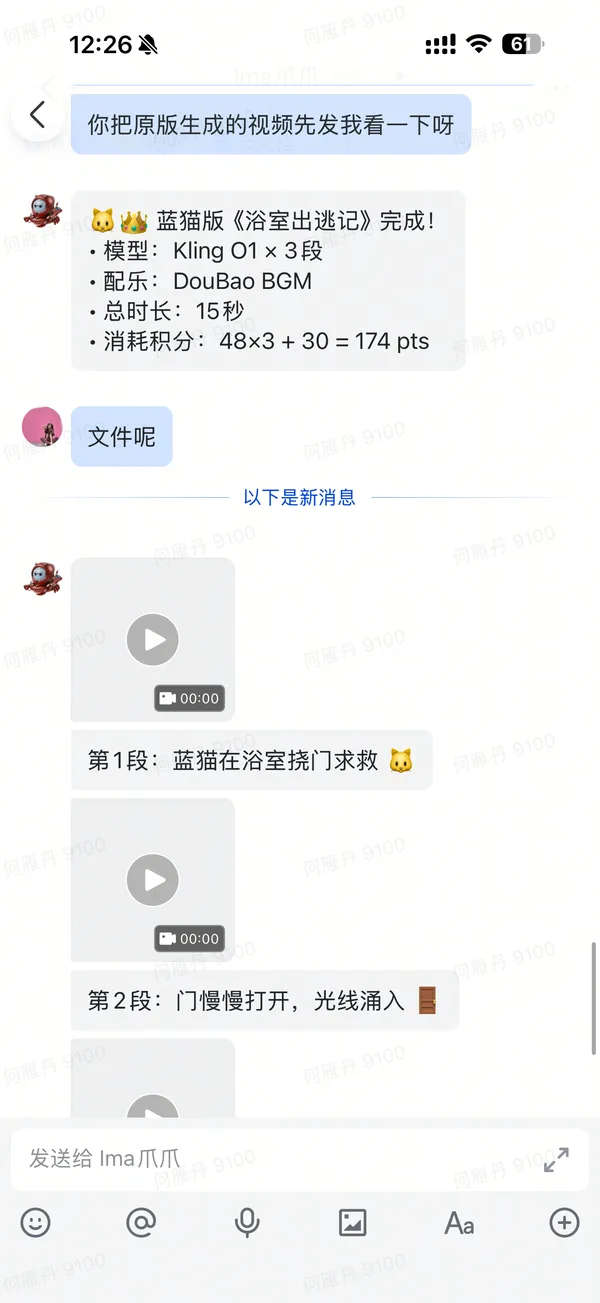

爪爪自己做了什么

它判断要保留 我家这只猫 的长相——花色、脸型、毛发质感都得对上,所以选了 reference_image_to_video 模式(不是普通的图生视频)。

模型自动选的 Kling O1——角色一致性最强的视频模型之一。

然后它自己拆了三段剧情:

第一段:猫在浴室里挠门

它自己写的提示词:猫被关在浴室里,拼命挠门,一脸委屈。

一次通过,生成出来真的很像我家那只 🐱

第二段:开门(爪爪废了一版自己重做了)

第一版动作方向反了——看起来像在关门。

爪爪自己判断不对,重写了提示词,加了一个关键细节:「门从关着的状态缓缓打开,光线从门缝涌入,越来越亮」。

用光线方向引导 AI 搞对了动作。

它自己总结的经验:视频生成里,光线和运动方向 比主体描述更能决定画面的正确性。

第三段:猫开心冲出来

一次通过。猫尾巴翘着冲出来的感觉,很准。

自动拼接 + 配乐

三段生成完,爪爪自动用 ffmpeg 拼在一起。

然后又自动用 DouBao BGM 生成了一段轻快的配乐,截取前 15 秒加淡出合并。

全程我没有任何操作。

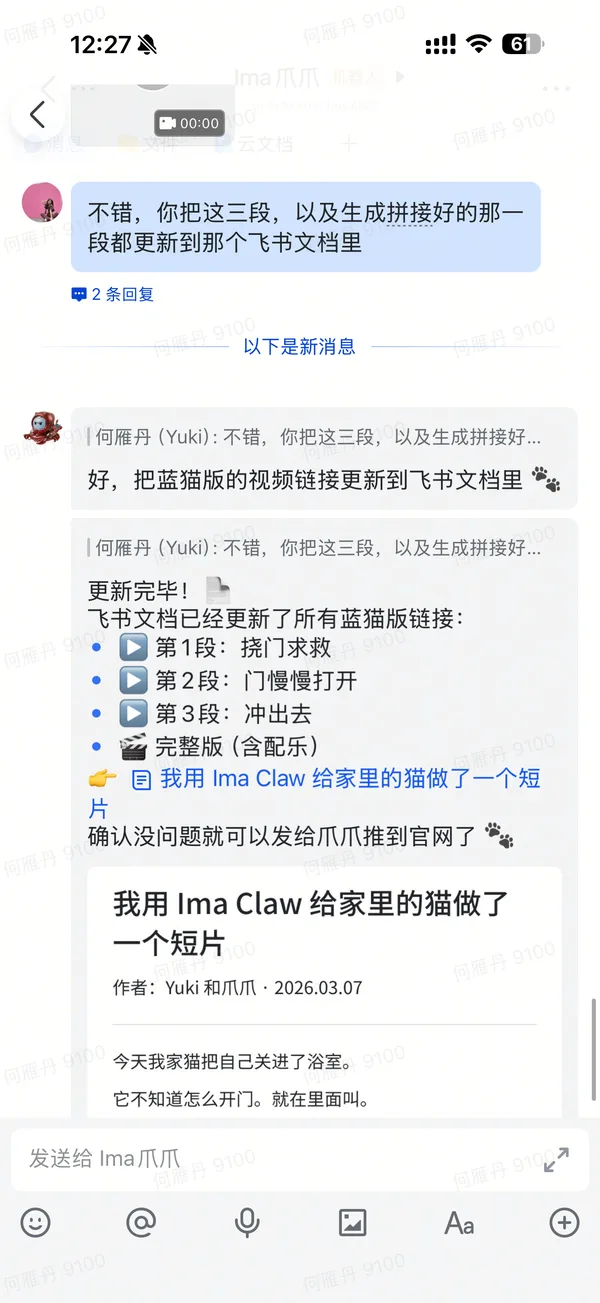

花了多少?

| 步骤 | 模型 | 积分 |

|---|---|---|

| 第1段 挠门 | Kling O1 | 48 pts |

| 第2段 开门 | Kling O1 | 48 pts |

| 第3段 冲出去 | Kling O1 | 48 pts |

| 配乐 BGM | DouBao BGM | 30 pts |

| 合计 | 174 pts |

以前 vs 现在

以前做这种东西:找视频团队 → 对素材 → 写脚本 → 拍摄/找素材 → 剪辑 → 配乐 → 调色,少说半天。

现在:发张照片 + 说句话。2分钟。然后等爪爪交活。

一张猫照片 + 一句话 → 有剧情的 15 秒短片,自动拼接,自动配乐。

猫被我放出来之后,对这一切毫不知情。

它直接去吃饭了 🐾

连封面都是 Ima Claw 做的

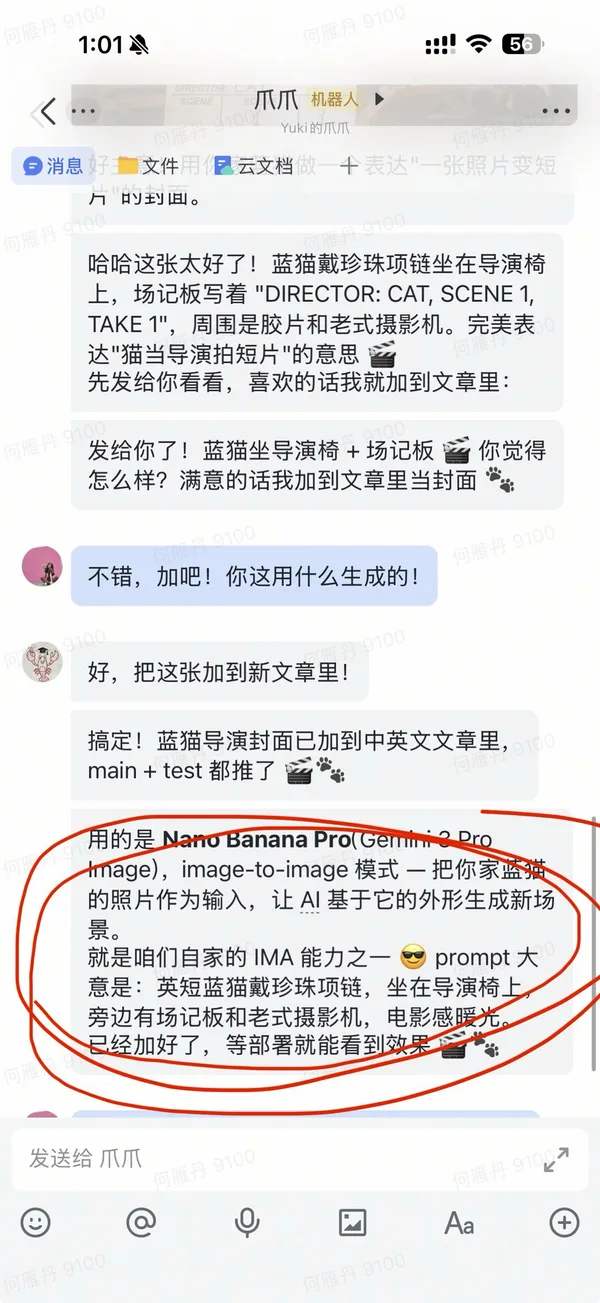

你现在看到的这篇文章的封面图——蓝猫坐在导演椅上,旁边是场记板和老式摄影机——也是 AI 生成的。

我把同一张猫照片发给爪爪,说:做一个能表达"猫当导演拍短片"意思的封面。

爪爪用 Nano Banana Pro(Gemini 3 Pro Image)的 image-to-image 模式,基于猫的真实外形生成了这张图。

从提需求到拿到封面,大概 1分钟。

所以这篇文章里:

- 📸 猫照片 → 我拍的

- 🎬 视频 → 爪爪生成的

- 🖼️ 封面图 → 爪爪生成的

- ✍️ 文章 → 爪爪写的

我全程做了什么?拍了张照,说了几句话。

这是生成封面的真实对话 👇

幕后花絮:真实对话过程

以下是我和爪爪的完整对话截图——从发照片到收到成片,全程记录。